Salesforce se guía por sus valores fundamentales de confianza, éxito del cliente, innovación, igualdad y sostenibilidad. Estos valores se reflejan en su compromiso de desarrollar y desplegar de forma responsable nuevas tecnologías como la IA generativa en nombre de las partes interesadas, desde los accionistas hasta los clientes y el planeta.

Los grandes modelos de lenguaje (LLM) que impulsan la IA generativa requieren enormes recursos informáticos para funcionar, lo que provoca impactos medioambientales negativos como las emisiones de carbono, el agotamiento del agua y la extracción de recursos dentro de la cadena de suministro. A medida que el mundo bate «récords de emisiones y temperaturas, que intensifican los fenómenos meteorológicos extremos y otros impactos climáticos en todo el planeta», la necesidad de reducir las emisiones que provocan el calentamiento del planeta es más acuciante que nunca. En un momento en el que cada tonelada adicional de carbono emitida importa, el desarrollo de tecnologías de IA no debe sobrepasar los límites planetarios.

Aunque los hipotéticos beneficios de sostenibilidad a largo plazo de la IA son significativos, con el potencial de reducir las emisiones globales entre un 5% y un 10% para 2030, Salesforce también sigue centrada en minimizar los impactos medioambientales a corto plazo.

>

–>

Boris comparte su punto de vista sobre la sostenibilidad y explica su papel en Salesforce

Sostenibilidad

Siga leyendo para conocer las estrategias de Salesforce para crear una IA sostenible, desarrolladas como una colaboración entre los equipos de Investigación de IA, Sostenibilidad y Oficina de Uso Ético y Humanitario.

Optimización de modelos

La energía necesaria para entrenar un modelo depende del número de sus parámetros y del tamaño de los datos de entrenamiento. Durante los últimos años, la tendencia ha sido aumentar significativamente ambos factores, lo que se traduce en un crecimiento exponencial (750 veces más cada 2 años) de los requisitos energéticos de los transformadores, la principal arquitectura LLM. De hecho, esta tendencia parece estar eclipsando la Ley de Moore, lo que sugiere que las mejoras en la eficiencia del hardware por sí solas no seguirán el ritmo de la creciente demanda computacional.

La cantidad de computación necesaria para entrenar varios modelos en comparación con la Ley de Moore. Fuente: Amir Gholami

Aunque ha habido una tendencia hacia modelos grandes y de propósito general, ¿es realmente necesario escribir código con el mismo modelo que puede crear sonetos de Shakespeare? Salesforce AI Research sigue centrándose en el desarrollo de modelos específicos para cada dominio, personalizados para las aplicaciones a las que están destinados.

La investigación de la inteligencia artificial se ha centrado en el desarrollo de modelos específicos para cada dominio

Por ejemplo, el modelo CodeGen del equipo, lanzado inicialmente en 2022, fue uno de los primeros LLM que permitía a los usuarios «traducir» lenguaje natural, como el inglés, a lenguajes de programación, como Python. La última versión – CodeGen 2.5 – se ha optimizado en términos de eficiencia mediante entrenamiento multiepoc y atención flash. El resultado es un modelo que rende tan bien como modelos más grandes con menos de la mitad de tamaño. Además de ser más sostenibles, el equipo aprendió que los modelos más pequeños son más rentables, más fáciles de ajustar y funcionan más rápido, mejorando la experiencia del usuario.

Utilizando hardware eficiente

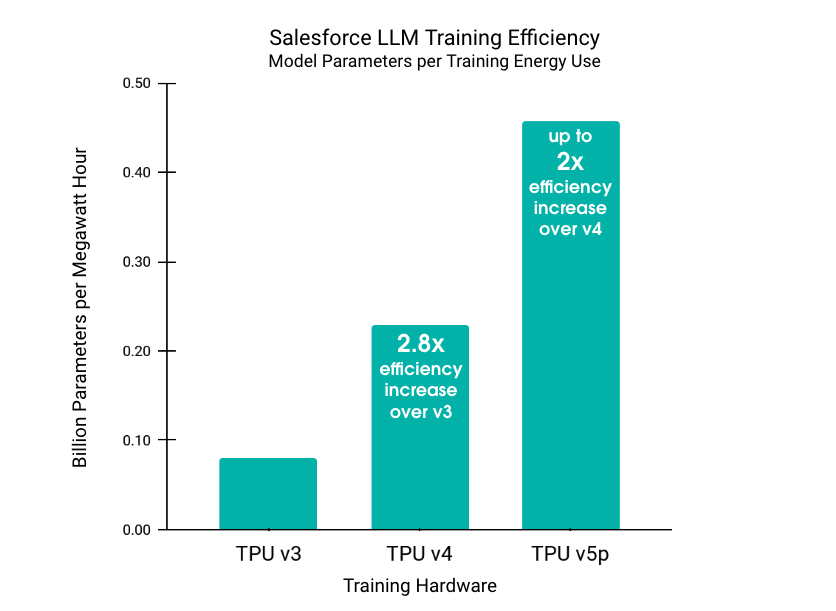

Una vez optimizado el modelo, es importante elegir un hardware eficiente para entrenar y desplegar la IA. Los fabricantes de hardware de IA presentan con frecuencia nuevas versiones con mejoras sustanciales de eficiencia. El hardware de IA de Google, Tensor Processor Unit (TPU), se ha vuelto más eficiente con cada nueva generación, y Salesforce AI Research ha aprovechado estos avances para la sostenibilidad. Los modelos más recientes del equipo se entrenan en TPU v4, mientras que algunos modelos más antiguos se entrenaban en TPU v3. Google estima que la TPU v4 más reciente es 2,7 veces más eficiente y los cálculos del equipo han confirmado esta afirmación, observando un 2,8 veces mayor eficiencia (medido promediando los parámetros del modelo por energía de entrenamiento consumida). Además, nuestras pruebas iniciales han descubierto que la flamante «TPU v5p supera a la TPU v4 de la generación anterior hasta en 2x«.

Se espera que estos aumentos de eficiencia continúen. Por ejemplo, Nvidia afirma que sus próximas GPU H200 multiplicarán por 18 el rendimiento de las GPU A100 que se utilizan hoy en día

Además del hardware de GPU/TPU especializado en IA, también se está avanzando en la implantación de la IA en CPU más tradicionales, presentes en ordenadores de consumo. CodeGen 2.5 puede desplegarse localmente hoy mismo, lo que se traduce en un menor consumo de energía, mayor velocidad, seguridad mejorada y personalización.

Priorizar los centros de datos con bajas emisiones de carbono

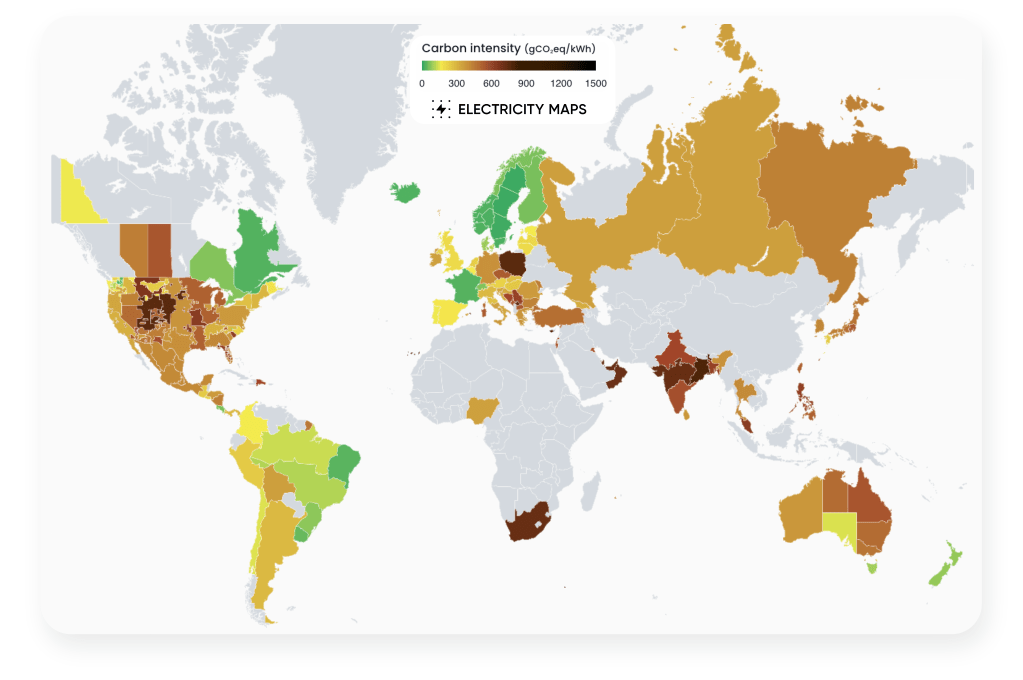

Las emisiones de los centros de datos varían mucho, ya que se alimentan de las redes eléctricas locales. Dependiendo de la dependencia de las redes de los combustibles fósiles, su intensidad de carbono puede variar drásticamente de una región a otra (véase el gráfico a continuación).

La diferente intensidad de carbono de las redes eléctricas del mundo (fuente: electricitymaps.com)

Con esto en mente, es importante ser consciente de qué centros de datos se utilizan para entrenar y desplegar la IA. Como resultado de que el equipo de investigación de IA entrene sus modelos en centros de datos con menos emisiones de carbono, Salesforce ha reducido las emisiones en un 68,8%1 , evitando 105 toneladas equivalentes de dióxido de carbono (tCO2e) en comparación con la media mundial.

Más allá del desarrollo de modelos de IA: Técnicas sostenibles de IA

El enfoque de sostenibilidad de la IA del equipo no termina con el desarrollo y despliegue de modelos. Al igual que con todos los productos de Salesforce, trabajan para garantizar que sus productos están diseñados con sostenibilidad en su núcleo, desde la arquitectura hasta la UX. Por ejemplo, cuando hay varios modelos de IA disponibles, elegimos por defecto la opción más eficiente y adecuada para cada caso de uso.

El diseño de los productos de Salesforce tiene en cuenta la sostenibilidad, desde la arquitectura hasta la experiencia del usuario

Además, las técnicas de ingeniería de avisos integradas en Prompt Builder optimizan la satisfacción del cliente, el coste y la sostenibilidad medioambiental, garantizando que nuestros sistemas de IA ofrezcan los mejores resultados con un uso mínimo de recursos. Al almacenar en caché tanto los mensajes como los resultados para almacenar y reutilizar las respuestas a consultas comunes, el equipo reduce significativamente los cálculos repetitivos, acelerando los tiempos de respuesta y el consumo de energía. El equipo también incorpora mecanismos como el seguimiento del uso y los límites de tarifa en su Plataforma Einstein 1 basada en Hyperforce, promoviendo un uso consciente, responsable y seguro de nuestros sistemas de IA.

Medición del impacto

La incorporación de estas estrategias al enfoque de desarrollo del equipo de AI Research ha dado como resultado modelos de IA con un nivel de emisiones de carbono significativamente menor. Para comprender este impacto, el equipo ha calculado las emisiones de energía y carbono del preentrenamiento de los modelos, que es, con diferencia, la fase del ciclo de vida de los modelos de IA que más impacto tiene:

Impactos medioambientales del preentrenamiento de modelos de IA de Salesforce

Emisiones energéticas y de carbono del preentrenamiento de modelos de IA

En total, el preentrenamiento de estos modelos generó 48 tCO2e: 11 veces menos que las emisiones de GPT-3. Más allá de la fase de entrenamiento, el impacto del uso continuado de nuestros modelos se ha divulgado en las tablas de clasificación de Hugging Face y ML.Energy.

e

El equipo cree que la transparencia es clave para la IA de confianza y sigue dedicado a compartir sus impactos medioambientales y las lecciones aprendidas, con la esperanza de que otros actores del ecosistema de la IA sigan su ejemplo. Para seguirnos en este viaje, consulta AI Research actualizaciones y explora los modelos en Hugging Face y GitHub.

Un enfoque holístico de la sostenibilidad

El compromiso de Salesforce con la sostenibilidad no consiste únicamente en reducir el impacto; se trata de aprovechar la IA para crear beneficios medioambientales tangibles. Las innovaciones en IA están mejorando los informes ESG dentro de nuestra Net Zero Cloud, ilustrando la creciente intersección entre tecnología y sostenibilidad corporativa. CodeGen, que impulsa Einstein for Developers y Einstein for Flow, mejora la eficiencia del código, con investigaciones de terceros que indican una mejora de 2,5 veces. Esta eficiencia mejorada se extiende también a los clientes de Salesforce, con herramientas potenciadas por IA que les permiten analizar y reducir automáticamente las emisiones de carbono de su código Apex.

Einstein for Flow

Además, el medio ambiente es un área de enfoque clave para el equipo de investigación de IA. Son pioneros en la IA para la cooperación climática mundial, utilizando la IA para elaborar protocolos de negociación y acuerdos climáticos que podrían dar forma a futuras políticas medioambientales. Además, su modelo de lenguaje de IA ProGen, diseñado para generar nuevas proteínas artificiales, está avanzando en el desarrollo de materiales compostables a partir de almidones de zanahoria. Otro proyecto notable es SharkEye, que emplea IA para detectar grandes tiburones blancos, contribuyendo a una base de datos vital para científicos, conservacionistas y comunidades locales.

Más información

___________________________________

1 El factor de carbono agregado ponderado de preentrenamiento del modelo Salesforce es de 136 gCO2e/kWh. 68.la reducción es del 8% en comparación con la media mundial de 436 gCO2e/kWh (fuente). la evitación de 105 tCO2e se compara con la media mundial.

2 La energía se calcula multiplicando el tiempo de formación, el TDP del procesador (utilizado para el supuesto conservador, proporcionado por el fabricante del procesador) y el PUE del centro de datos (proporcionado por el propietario del centro de datos).

3 El carbono se calcula multiplicando la energía por la intensidad de carbono de la red eléctrica (proporcionada por el propietario del centro de datos).

4 Emisiones de carbono debidas únicamente a la electricidad. Aunque los fabricantes no proporcionan actualmente datos sobre el carbono incorporado, esperamos ampliar el alcance del cálculo en el futuro.

5 A través de una combinación de adquisición de energía renovable y créditos de carbono de alta calidad, todas las emisiones residuales son compensadas en su totalidad por Salesforce y/o nuestros proveedores.

Las emisiones de carbono se calculan multiplicando la energía por la intensidad de carbono de la red eléctrica (proporcionada por el propietario del centro de datos)