Si es un socio ISV de Salesforce, este blog le ofrece las funciones más importantes para usted en la versión Summer ’24.

The post Notas de la versión para ISV en Summer ’24 appeared first on Blog de desarrolladores de Salesforce.

Si es un socio ISV de Salesforce, este blog le ofrece las funciones más importantes para usted en la versión Summer ’24.

The post Notas de la versión para ISV en Summer ’24 appeared first on Blog de desarrolladores de Salesforce.

Este artículo del blog explora el nuevo Conector PostgreSQL de Heroku, por qué es importante para los desarrolladores y las nuevas posibilidades que abre para las aplicaciones Heroku.

The post Por qué el Conector PostgreSQL de Heroku para Data Cloud es importante para los desarrolladores appeared first on Blog de desarrolladores de Salesforce.

Con el poder de los grandes modelos de lenguaje y Prompt Builder, puede clasificar y resumir objetos estándar o personalizados de Salesforce fácilmente.

The post Utilizando Prompt Builder, Flows y Apex para resumir y clasificar casos más rápidamente appeared first on Blog de Desarrolladores de Salesforce.

Los desarrolladores ya pueden navegar por las aplicaciones de consola desde los componentes web de Lightning con la API del espacio de trabajo. Empieza hoy mismo!

The post Navegue por las aplicaciones de consola desde los componentes web de Lightning con la API del espacio de trabajo appeared first on Blog de desarrolladores de Salesforce.

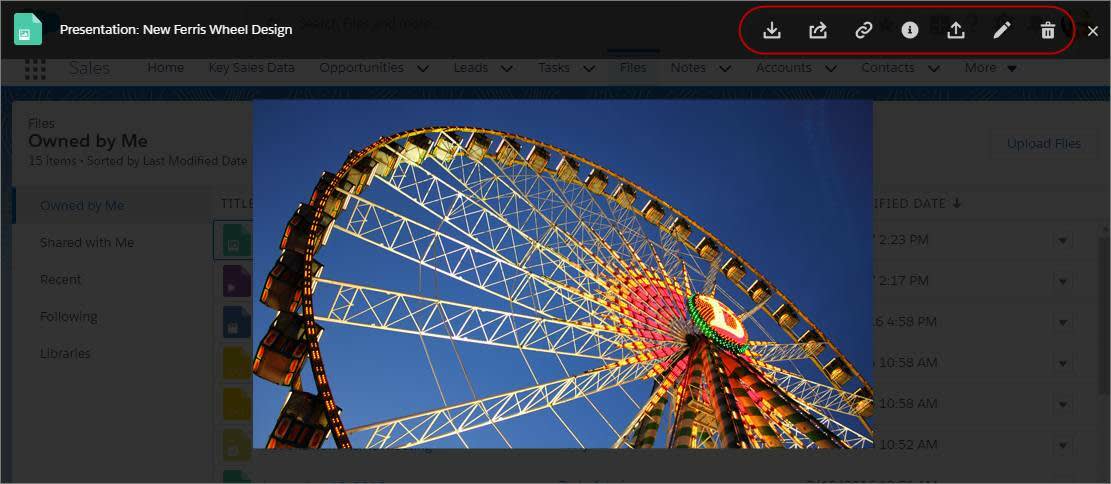

Los cambios de Lightning UI están relacionados únicamente con el estilo visual y no afectan a la plataforma, las características del producto ni la funcionalidad.

The post Lo que los desarrolladores deben saber sobre las mejoras de Lightning UI en la versión Summer ’24 appeared first on Blog de desarrolladores de Salesforce.

Para mantener el valor de la confianza, los desarrolladores deben tener siempre la seguridad en mente, incluso después de pasar la revisión de seguridad de AppExchange.

<p

The post Desarrollo seguro para AppExchange appeared first on Blog de desarrolladores de Salesforce.

Comience a ingerir datos de eventos y perfiles de Amazon Kinesis mediante el conector de Amazon Kinesis en Data Cloud.

The post Cómo utilizar el conector de Amazon Kinesis en Data Cloud appeared first on Blog de Desarrolladores de Salesforce.

Cómo utilizar el conector de Amazon Kinesis en Data Cloud

La API LocationService permite utilizar las capacidades nativas de un dispositivo móvil para determinar la ubicación GPS de un usuario y solicitar actualizaciones de cambios de ubicación.

La API LocationService permite utilizar las capacidades nativas de un dispositivo móvil para determinar la ubicación GPS de un usuario y solicitar actualizaciones de cambios de ubicación

The post Busque y rastree la ubicación en aplicaciones móviles con la API LocationService de LWC appeared first on Blog de desarrolladores de Salesforce.

Descubra cómo el modelo de responsabilidad compartida beneficia tanto a Salesforce como a nuestros clientes, así como la forma de corregir errores comunes de configuración.

Data Cloud y la inteligencia artificial de Salesforce forman una base importante que los desarrolladores ahora pueden utilizar para impulsar nuevas capacidades utilizando datos y modelos de IA que antes eran inalcanzables.

The post Data Cloud + Einstein AI: Guía de bolsillo para desarrolladores appeared first on Blog para desarrolladores de Salesforce.

Google Chrome está eliminando gradualmente las cookies de terceros e introduciendo cambios en las API de almacenamiento, lo que puede afectar a su org.

Los usuarios de Salesforce pueden probar Salesforce en Google Chrome

The post Prepárese para la iniciativa Sandbox de privacidad de Google Chrome appeared first on Blog de desarrolladores de Salesforce.

Prepárese para la iniciativa Sandbox de privacidad de Google Chrome

La capacidad móvil BiometricsService permite a los desarrolladores añadir medidas de seguridad adicionales a los datos que se almacenan en los LWCs.

The post Presentación de la función móvil BiometricsService appeared first on Blog de desarrolladores de Salesforce.

Con la capacidad móvil de NFCService, puede actualizar registros a través de LWCs utilizando las capacidades nativas de NFC fácilmente disponibles en dispositivos iOS y Android.

The post Presentación de la función móvil NFCService appeared first on Blog de desarrolladores de Salesforce.

La convocatoria de participación de Dreamforce 2024 ya está abierta Complete el proceso de envío antes del 6 de junio para que se tenga en cuenta su propuesta de sesión de seguimiento de desarrolladores.

The post La convocatoria de participación para Dreamforce 2024 ya está abierta appeared first on Blog de desarrolladores de Salesforce.

La función de suscripciones gestionadas le permite integrarse con el bus de eventos de Salesforce de forma eficaz utilizando ID de repetición.

La función de suscripciones gestionadas le permite integrarse con el bus de eventos de Salesforce de forma eficaz utilizando ID de repetición

The post La API Pub/Sub se simplifica mediante las suscripciones gestionadas (Beta abierta) appeared first on Blog de desarrolladores de Salesforce.

¡Ya está aquí la versión Summer ’24! En este post, destacamos las novedades para los desarrolladores de todo el ecosistema de Salesforce.

En este post, destacamos las novedades para los desarrolladores de todo el ecosistema de Salesforce

The post Guía del desarrollador de Salesforce para la versión de verano ’24 appeared first on Blog de desarrolladores de Salesforce.

La versión de verano ’24 ya está aquí

Es un buen momento para explorar y desarrollar con las API de Salesforce utilizando el espacio de trabajo de Postman para desarrolladores de Salesforce.

El post Postman para desarrolladores de Salesforce

The post Comience a utilizar las API de Salesforce gracias a los recursos galardonados appeared first on Blog de desarrolladores de Salesforce.

En esta publicación del blog, le ayudaremos a determinar qué tipo de organización debe utilizar al navegar por su viaje de desarrollo de Salesforce.

The post Elija la organización de Salesforce adecuada para el trabajo adecuado appeared first on Blog de desarrolladores de Salesforce.

Los desarrolladores ahora pueden obtener información sobre el rendimiento, el uso y los aspectos de seguridad de sus aplicaciones con la Logger API

The post Comience a utilizar Logger API para LWC personalizados appeared first on Blog de desarrolladores de Salesforce.

Los desarrolladores ahora pueden obtener información sobre el rendimiento, el uso y la seguridad de sus aplicaciones con Logger API

Salesforce Data Cloud le permite incluir atributos relacionados durante la activación a Marketing Cloud. Los atributos relacionados están vinculados a objetos de modelo de datos (DMO) que tienen una relación 1:N con el objeto utilizado para la segmentación. Un ejemplo de atributos relacionados sería cuando el individuo utilizado para la segmentación es el individuo, y el historial de compras podría ser […]

The post Parar JSON desde Data Cloud en Marketing Cloud para admitir divisiones de Journey Builder appeared first on Blog de desarrolladores de Salesforce.

Descubrir por dónde empezar puede ser difícil para un nuevo desarrollador, independientemente de la plataforma, pero una buena hoja de ruta puede hacerlo más fácil.

El artículo El desarrollador principiante en la plataforma Salesforce es un buen ejemplo

The post Guía para principiantes para empezar a desarrollar en Salesforce appeared first on Blog de desarrolladores de Salesforce.

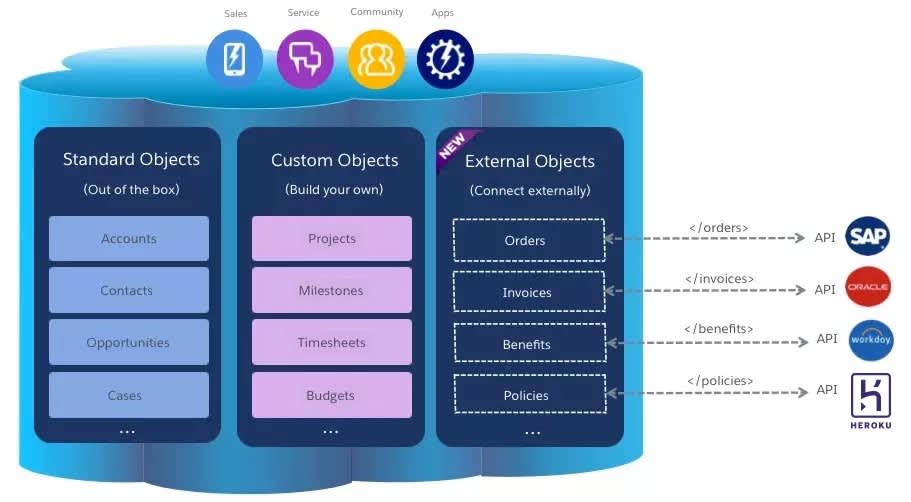

La plataforma Salesforce proporciona una gran variedad de API con una amplia gama de funciones para acceder a los datos de su organización. Este blog le ayuda a decidir qué API son las más adecuadas para su caso de uso.

La plataforma Salesforce ofrece una gran variedad de API con una amplia gama de funciones para acceder a los datos de su organización

The post Acceso a datos de objetos con las API de Salesforce Platform appeared first on Blog de desarrolladores de Salesforce.

Aprenda a configurar su SDK web y las distintas funciones como la gestión de consentimientos, la gestión de usuarios y los sitemaps que ofrece el SDK web.

The post Utilización del SDK Web de Data Cloud para captar la participación en su sitio Web appeared first on Blog de desarrolladores de Salesforce.

En este post del blog, te daremos una visión general de las diferentes técnicas de conexión a tierra que puedes utilizar para personalizar las plantillas de avisos sin límites.

The post Ground Your Prompt Templates with Data Using Flow or Apex appeared first on Blog de desarrolladores de Salesforce.